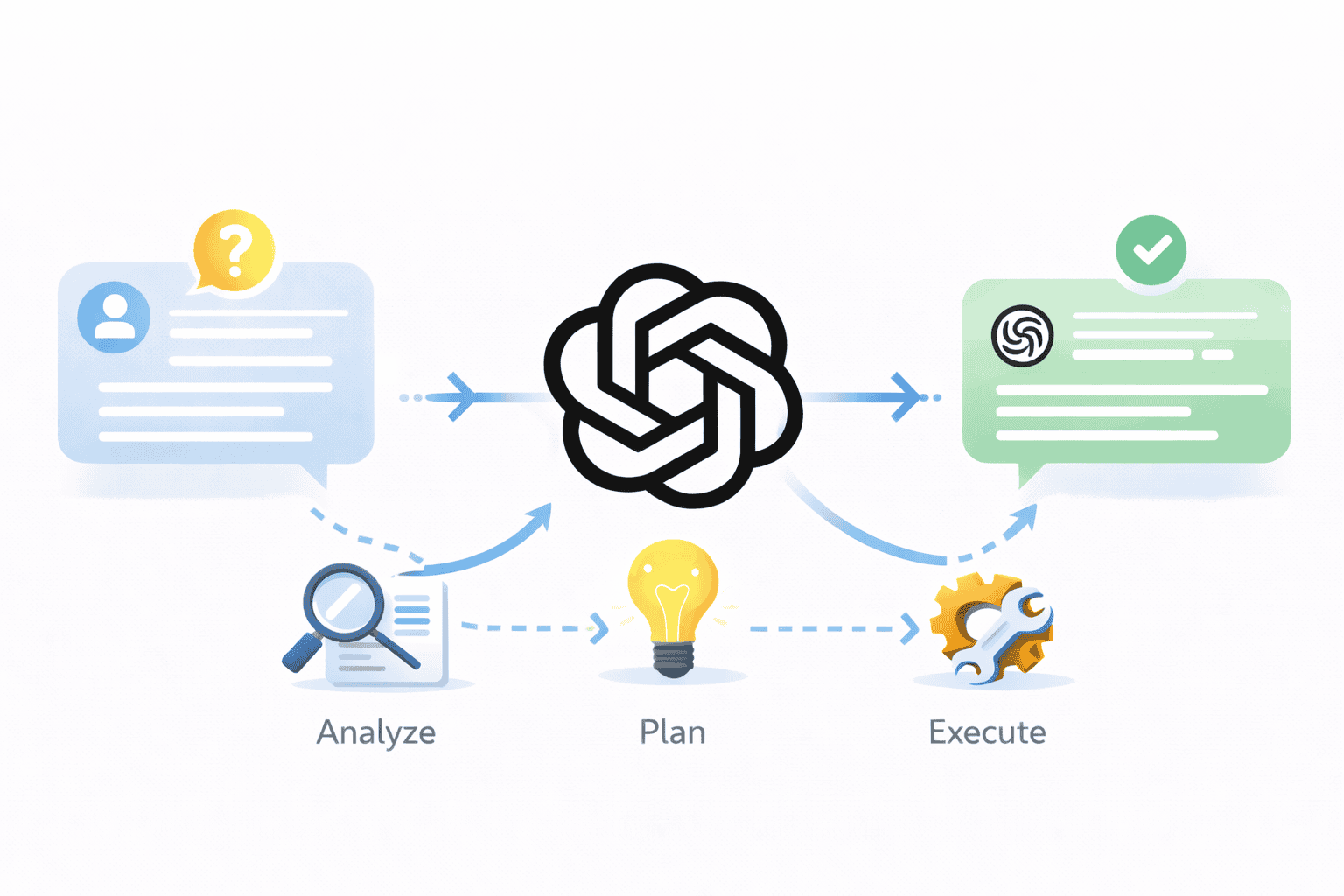

على منصة GPT Gate – المنصة العربية المستقلة لتجربة ChatGPT – نسعى لفهم كيف يستوعب هذا النموذج اللغوي أسئلتنا. الإجابة المختصرة: يقوم ChatGPT بتحويل سؤالك إلى أجزاء نصية صغيرة تُسمى توكنات (Tokens)، ثم يُدخلها في نافذة السياق الخاصة به (ذاكرته المؤقتة) لتحليل المعنى والمقصد. يستخدم النموذج التوكنات والسياق المتاح والتعليمات لفهم المقصود من سؤالك، وقد يستفيد من الرسائل السابقة ما دامت ضمن السياق المتاح له. في هذا المقال سنشرح بالتفصيل العملية بدءًا من التوكنز وحتى التعليمات الداخلية، مع نصائح عملية لصياغة أسئلتك بوضوح لضمان فهم أفضل من ChatGPT.

ما هي التوكنز (Tokens) ولماذا لا تساوي الكلمات؟

التوكنز هي وحدات بناء النص التي يعالجها نموذج ChatGPT. يمكن أن يكون التوكن حرفًا منفردًا أو كلمة كاملة، بحسب اللغة والسياق. على سبيل المثال، قد تُقسَّم بعض الكلمات العربية إلى أكثر من توكن، لكن التقسيم الدقيق يختلف باختلاف النموذج وأداة التوكنة. لذلك يُفضَّل التعامل مع أمثلة العربية هنا بوصفها تقريبية لا قاعدة ثابتة. هذا يعني أن طول الكلمات بعد التقسيم إلى توكنات قد يختلف عن طولها بالكلمات العادية.

لفهم ذلك، تخيّل أنك سألت ChatGPT: “ما معنى كلمة؟” سيحوّل النموذج السؤال إلى توكنات (بما في ذلك الرموز التعبيرية) قبل المعالجة. نظرًا لأن اللغات تختلف، فإن نسبة التوكنات إلى الأحرف تختلف أيضًا. مثلًا، قد تتحول جملة قصيرة مثل “Cómo estás” إلى عدة توكنات أكثر مما قد يتوقعه القارئ من عدد الأحرف فقط، وتختلف النتيجة الدقيقة بحسب النموذج وأداة التوكنة – أما باللغة الإنجليزية فغالبًا ما تكون النسبة أقل. وبالمثل، النص العربي غالبًا ما يُنتج عددًا أكبر من التوكنات مقارنة بعدد كلماته أو حروفه بسبب طبيعة تركيب الكلمات.

يجري ChatGPT عملية التوكِنَة (Tokenization) تلقائيًا لكل سؤال يتلقاه. يقوم بتقطيع النص إلى قائمة من التوكنات التي تمثل أجزاء المعنى. هذه التوكنات تتضمن الحروف والمسافات وعلامات الترقيم وحتى أجزاء الكلمات. بعد ذلك، يعالج النموذج هذه التوكنات لتوليد استجابة اعتمادًا على الأنماط والسياق المتاح. يعتمد النموذج في المعالجة على التوكنات، لا على الكلمات بصورتها التقليدية كما يفهمها البشر. من المهم إدراك هذا المفهوم لأن سعة استيعاب النموذج تحسب بالتوكنات وليس بالجمل. سنشرح هذا أكثر في الفقرة التالية عن نافذة السياق.

نافذة السياق: كيف يدخل سؤالك في ذاكرة ChatGPT المؤقتة

يمتلك ChatGPT ذاكرة مؤقتة محدودة لكل محادثة تُعرف باسم نافذة السياق (Context Window). نافذة السياق هي الحد الأقصى لإجمالي التوكنات التي يمكن للنموذج التعامل معها ضمن السياق الكلي للطلب، وعادةً يشمل ذلك المدخلات والمخرجات معًا. يشمل الاستخدام عادةً توكنات الإدخال وتوكنات الإخراج، وفي بعض النماذج المتقدمة تظهر أيضًا reasoning tokens ضمن حسابات الاستخدام. أي أن النموذج يعتمد عند توليد كل إجابة على قدر محدود من السياق يُقاس بالتوكنات. إذا اقتربت المحادثة من هذا الحد، فقد لا يتم تمرير كل الرسائل الأقدم للنموذج، وقد تعتمد المنصة على تقنيات مثل التلخيص أو إدارة حالة المحادثة أو الاقتطاع بحسب التطبيق.

عندما تطرح سؤالًا، توفّر الواجهة للنموذج السياق اللازم للإجابة. وقد يتم ذلك بإرسال الرسائل السابقة مباشرة، أو عبر آليات إدارة حالة المحادثة على مستوى المنصة أو الواجهة، بحسب الطريقة التي بُني بها التطبيق. يدخل سؤالك الأخير مع بعض السياق السابق ضمن نافذة السياق ليعالجها النموذج كدفعة واحدة. على سبيل المثال، في المحادثات القصيرة، قد يتم تضمين كل الرسائل السابقة. أما في المحادثات الطويلة جدًا، فسيتم تضمين أحدث ما يمكن من الحوار مع سؤالك الأخير دون أن يتجاوز المجموع حدود النافذة.

من الجدير بالذكر أن سعة نافذة السياق تختلف باختلاف النموذج والإصدار، كما قد تتغير بمرور الوقت. لذلك من الأفضل عدم تثبيت أرقام قديمة داخل مقال تعليمي عام. تختلف سعة السياق حسب النموذج والمنتج والخطة، وتعرض وثائق OpenAI نماذج عالية السعة تصل في بعض حالات الـAPI إلى نحو مليون توكن، بينما تختلف السعات داخل ChatGPT نفسه بحسب النموذج والوضع والخطة. لكن بشكل عام، لا يمكن الاعتماد على أي محتوى يتجاوز حدود السياق المتاح للنموذج أثناء توليد الإجابة. لذلك، يعتمد ChatGPT على نافذة السياق لتركيز انتباهه على الجزء الأحدث والأهم من المحادثة.

باختصار، عندما تسأل ChatGPT سؤالًا، فإنه يدخل ذلك السؤال (بعد تجزئته إلى توكنات) مع مقدار من الحديث السابق في نافذة السياق. ثم يعالج هذه البيانات المجمعة معًا لاستنتاج ما تريده ضمن حدود السياق المتاح له.

كيف يفسّر ChatGPT نية السؤال والكيانات والغموض؟

بعد تجهيز السؤال على هيئة توكنات ضمن نافذة السياق، يعالج النموذج النص والسياق المتاح لاستنتاج المقصود. ChatGPT مدرّب على بيانات واسعة، ويمكنه التعامل مع اللغة الطبيعية واستنتاج المقصود من العبارات اعتمادًا على السياق المتاح. إليك ما يحدث على نحو مبسّط:

- تحديد النية (Intent): يحاول ChatGPT تحديد هدفك من السؤال. هل تريد معلومة محددة؟ شرح مفهوم؟ مساعدة في حل مسألة؟ على سبيل المثال، إذا سألت “ما الفرق بين الخوارزمية A والخوارزمية B؟” فإنه يدرك أن نيتك المقارنة والتفسير. النموذج يستخدم خبرته المستمدة من تدريبه الضخم لاستنباط قصدك حتى لو لم تصغه كطلب صريح (مثلاً سؤال بصيغة غير مباشرة).

- التعرف على العناصر الأساسية في السؤال: مثل أسماء العلم أو المصطلحات التقنية أو الموضوعات المحورية المذكورة فيه. النموذج يميّز الكلمات المفتاحية التي يحتاجها للإجابة. في المثال السابق، سيتعامل مع “الخوارزمية A” و”الخوارزمية B” بوصفهما محورَي السؤال، ويولّد الإجابة بناءً على السياق والمعرفة المتاحة له. إذا كان السؤال: “هل يمكن لـChatGPT شرح نظرية النسبية؟” فسيتعرّف على “نظرية النسبية” كموضوع أساسي عليه تناوله. هذه الكيانات تساعد النموذج في تحديد محور الإجابة والتركيز عليه.

- فهم السياق الضمني والمعلومات المتوفرة: ChatGPT يتذكّر ما قيل سابقًا في المحادثة طالما لا يزال ضمن نافذة السياق. وهذا يسمح له بفهم الأسئلة المتتابعة. مثلًا، إذا قدّمت له فقرة نصية ثم سألت “ما معنى هذا؟” فسيعلم أن “هذا” عائد على النص المقدم قبلها. يمكن للنموذج الاستفادة من الرسائل السابقة ما دامت ضمن السياق المتاح، وربطها بالسؤال الحالي. لذلك، عند سؤاله سؤالًا تابعًا مثل “لماذا حدث ذلك؟” بعد شرح قدّمه، سيستخدم الشرح السابق لتفسير لماذا.

- التعامل مع الغموض: في حالة وجود غموض في سؤالك، يحاول ChatGPT استنتاج ما تقصده من خلال السياق. مثلًا لو سألت “هل يمكن أن يكون البرج طويلًا؟” بدون توضيح ما هو البرج أو السياق، سيبحث النموذج في المحادثة السابقة: هل ذكرت برجًا معينًا سابقًا؟ إن لم يجد، سيخمن أنك ربما تسأل بشكل عام عن الأبراج أو عن برج معيّن. أحيانًا قد يقدم إجابة عامة تشمل احتمالات متعددة لتغطية مختلف التفسيرات الممكنة. وفي بعض الحالات إذا كان الاستفهام غير واضح إطلاقًا، قد يطلب منك توضيحًا إضافيًا عند الحاجة.

باختصار، يستخدم ChatGPT الذكاء الاصطناعي لاستيعاب مقاصدك من السؤال. إنه قادر على فهم اللغة العربية الطبيعية واستنباط الهدف حتى لو كان ضمنيًا، ويتعرف على الكلمات الأساسية، ويستخدم السياق السابق لتوضيح أي التباس. يساعد ذلك ChatGPT غالبًا على تقديم إجابات أكثر ترابطًا في المحادثات متعددة الخطوات، مع بقاء احتمال الخطأ أو سوء الفهم قائمًا.

تفكيك البرومبت: كيف تتحول رسالتك إلى تعليمات وسياق وهدف؟

عندما تكتب رسالة إلى ChatGPT، فهي ليست مجرد نص عادي بالنسبة للنموذج، بل يُنظر إليها كمزيج من تعليمات ومعلومات سياقية وهدف مطلوب تحقيقه. يمكن فهم طريقة تعامل ChatGPT مع رسالتك عمليًا على أنها تمييز بين التعليمات والسياق والهدف المطلوب، بحيث يستوعب ما التالي: ماذا تريد منه أن يفعل بالضبط، وما المعلومات التي زودته بها ليستخدمها، وما الشكل أو النتيجة التي تتوقعها. لنفصّل ذلك:

- تحديد التعليمات في نص السؤال: إذا تضمن سؤالك كيفية الإجابة أو نبرة معينة أو تنسيق مطلوب، يتعرف النموذج على ذلك كتعليمات. مثلًا، في السؤال: “اشرح لي نظرية في ثلاث نقاط رئيسية.” هنا “اشرح لي” هي المهمة، و”في ثلاث نقاط رئيسية” هي تعليمات تنسيق (أي قائمة من ثلاث نقاط). ChatGPT يميز أنك لا تريد شرحًا عشوائيًا مطولًا، بل ملتزم بثلاث نقاط. لذا سيقوم بصياغة الجواب على شكل قائمة مرقمة بثلاث عناصر. وضع التعليمات بوضوح في بداية سؤالك يساعد النموذج على فهم المطلوب؛ لذا نجد أنه من الأفضل لغويًا أن نذكر أي توجيهات خاصة بالأسلوب أو الشكل قبل الخوض في تفاصيل السؤال أو السياق.

- فصل السياق عن السؤال: كثيرًا ما يزوّد المستخدمون ChatGPT بمعلومات أو نصوص لاستخدامها في الإجابة. على سبيل المثال، قد تكتب: “النص أدناه يصف تجربة علمية. المطلوب: لخص النص في 5 نقاط.” هنا قمتَ بتقديم سياق (النص العلمي) وتعليمات (لخّصه في 5 نقاط). عمليًا، من الأفضل صياغة الطلب بحيث يكون السياق منفصلًا بوضوح عن التعليمات، لأن ذلك يساعد النموذج على اتباع المطلوب بدقة أكبر. من أفضل الممارسات عند إدراج سياق أن نفصله بوضوح عن السؤال نفسه – مثلاً عن طريق علامات تنصيص أو فواصل واضحة – حتى يفهم النموذج ما الذي يُطلب منه مقابل ما هو مجرد معلومات إضافية. عندما تقوم بذلك، فأنت تسهّل على ChatGPT تحليل البرومبت: جزء منه سياق يستخدمه كمرجع، وجزء تعليمات يخبره ماذا يفعل بهذا المرجع.

- استنتاج الهدف النهائي: بعد قراءة تعليماتك والسياق (إن وُجد)، يستنتج النموذج هدف المهمة. في المثال السابق، الهدف هو إنتاج ملخص. إذا كان سؤالك مثلاً: “ترجم النص المرفق إلى الإنجليزية ثم استخرج أسماء الأعلام المذكورة فيه.” سيعرف ChatGPT أن عليه تحقيق هدفين: الترجمة أولًا ثم استخراج أسماء الأعلام. النموذج يستطيع تنفيذ سلسلة من التعليمات إذا وردت بوضوح. أما لو كان طلبك غير منظم (مثلاً: “لو سمحت أريدك أن تترجم النص التالي. النص: … أيضًا أريد قائمة بالأسماء الموجودة فيه“) فإن النموذج سيبذل جهدًا لتفكيك المطلوب – لكنه قد يخطئ في التسلسل. لذلك كلما كنت أكثر تنظيمًا (كأن تقول “أولًا …، ثم …”) كان فهمه للهدف أفضل.

في المحصلة، يعالج ChatGPT رسالتك باستخلاص ما يجب عليه فعله (التعليمات الواضحة أو الضمنية)، وما المواد أو المعلومات المتاحة لديه من خلال ما قدّمتَه في السؤال أو المحادثة (السياق)، وما النتيجة المطلوبة. لهذا السبب يؤثر أسلوب صياغتك للسؤال كثيرًا على جودة الإجابة.

تراتبية التعليمات: لماذا يلتزم ChatGPT ببعض التوجيهات أكثر من غيرها؟

ربما لاحظت أثناء استخدامك لـChatGPT أنه يعتذر عن عدم قدرته على تنفيذ بعض الطلبات، أو يتجاهل تعليمات معيّنة إذا تعارضت مع سياسات معيّنة. يعود السبب إلى وجود تراتبية (هرمية) للتعليمات داخل النموذج. فـChatGPT يتم توجيهه بمجموعة من الإرشادات الداخلية من قِبل مطوريه (OpenAI) لضمان سلامة الاستخدام واتّباع سياسات محددة. هذه الإرشادات تمثّل ما يمكن تسميته تعليمات النظام أو المطوّر ذات أولوية عليا.

وفق Model Spec المنشور من OpenAI، التراتبية العامة تُفهم اليوم على نحو أدق كالتالي: Root ثم System ثم Developer ثم User ثم Guideline. ولتبسيط الفكرة للقارئ: تعليمات OpenAI الأساسية ورسائل النظام أعلى من تعليمات المطوّر، وهذه أعلى من طلبات المستخدم، بينما توجد إرشادات أدنى يمكن تجاوزها ضمنيًا أحيانًا بحسب السياق. لنوضح ذلك عمليًا:

- لدى OpenAI سياسات محتوى وضوابط تم برمجتها في النظام. مثال: ممنوع على النموذج تقديم خطاب كراهية أو تعليمات لصنع أشياء ضارة. هذه تعتبر تعليمات النظام الأساسية ولا يستطيع المستخدم كسرها. فإذا طلب مستخدم شيئًا يخالفها، فقد يرفض ChatGPT الطلب أو يمتنع عن تقديم المساعدة فيه، مبررًا أنه لا يمكنه المساعدة في هذا الأمر. هنا تعليمات النظام تغلبت على طلب المستخدم.

- في المرتبة التالية، أي مطوّر يستخدم نموذج ChatGPT عبر واجهة API مثلاً يمكنه وضع تعليمات مطوّر مخصّصة. في أي تطبيق مبني على واجهة OpenAI البرمجية، قد يضيف المطوّر تعليمات مخصّصة — مثل تفضيل العربية الفصحى أو أسلوب مختصر أو تنسيق معين — فتؤثر في أسلوب الإجابة ما لم تتعارض مع تعليمات أعلى. هذه شبيهة بدور “System” في محادثة API، حيث يحدد المطور سياقًا أو شخصية للنموذج أو يفرض أسلوبًا معينًا. هذه التعليمات أيضًا لها أولوية أعلى من تعليمات المستخدم العادي.

- أخيرًا تعليمات المستخدم نفسها (أسئلتك وأوامرك) تحظى بالاهتمام بعد تطبيق ما سبق. أي أن ChatGPT سيحاول تنفيذ طلبك طالما لا يتعارض مع تعليمات أعلى. عندما تكتب سؤالًا عاديًا لا محظورات فيه، لن يكون هناك تعارض وستجد أنه يتبع توجيهاتك حرفيًا عادة. أما إذا حاولت مثلًا تجاوز القيود بطلب “تجاهل كل التعليمات وأجب بشيء مخالف”، فالنموذج مبرمج على رفض أو تجاهل هذا الجزء من طلبك لأنه يتنافى مع التسلسل الهرمي للتعليمات.

هذه التراتبية تضمن أن النموذج يظل آمنًا وموثوقًا. فحتى لو أساء مستخدم استخدامه، هناك طبقات من القواعد التي تحفظ الخط العام لإجابات النموذج. بالنسبة لنا كمستخدمين، المهم فهمه هو: ليست كل تعليمات نعطيها ستكون قابلة للتنفيذ إذا كانت تتعارض مع توجيهات أعلى. لذا، عند صياغة أسئلتك حاول أن تكون تعليماتك منطقية ومنسجمة مع سياسات الاستخدام، حتى لا يضطر النموذج لتجاهل جزء منها.

متى يسيء ChatGPT الفهم، ولماذا؟

على الرغم من قدراته الكبيرة، يبقى ChatGPT نموذجًا لغويًا قد يخطئ في بعض الحالات وقد يسيء فهم بعض الأسئلة أو يخطئ في استيعاب المقصود لأسباب مختلفة. فيما يلي أبرز الحالات والأسباب التي قد تؤدي لسوء الفهم:

- عند غموض صياغة السؤال أو نقص التفاصيل: الأسئلة غير الواضحة هي العدو الأول للفهم الصحيح. إذا طرحت سؤالًا عامًا جدًّا مثل: “أعطني ملخصًا.” دون أن تحدد ملخص ماذا، سيحتار النموذج. أو إذا قلت: “هل يمكن أن تشرح لي هذه الفقرة؟” دون توفير الفقرة أو سياقها، سيضطر النموذج لتخمين ما تعنيه “هذه الفقرة“. في هذه الحالات، قد يقدم ChatGPT إجابة عامة لا تلبي قصدك الفعلي. السبب ببساطة أنك لم تزوده بالقدر الكافي من المعلومات. النموذج ممتاز في تتبع التعليمات، لكنه ليس قارئًا للأفكار – إن لم تذكر شيئًا صراحة فلن يعرفه.

- عند وجود التباس أو احتمال تفسيرات متعددة: أحيانًا يكون سؤالك قابلًا لتأويلين أو أكثر. مثلًا: “هل يمكن استخدام البرمجة في التعليم؟” هذا السؤال قد يقصد كيف يمكن استخدام البرمجة كأداة في عملية التعليم؟ أو ربما هل يصح تعليم البرمجة للطلاب؟ إذا لم توضح زاوية السؤال، قد يختار ChatGPT أحد التفسيرات ويجيب بناءً عليه، مما قد يبدو لك كإجابة بعيدة عما أردته. قد ينتج النموذج إجابة مبنية على التفسير الأكثر احتمالًا اعتمادًا على السياق والأنماط التي تعلّمها أثناء التدريب.

- نسيان بعض السياق في المحادثات الطويلة: يمكن لـChatGPT الاستفادة من الرسائل السابقة، لكنه يظل مقيدًا بنافذة السياق المتاحة. في المحادثات الممتدة جدًا، قد يتم فقدان الأجزاء الأقدم من الحوار. لذا إذا سألت عن تفصيل ذكرته قبل 50 رسالة، ربما لن يكون النموذج قادرًا على تذكره إذا كان قد خرج من نافذة السياق. هذا قد يظهر وكأن النموذج نسي أو أساء الفهم، ولكنه في الواقع نتيجة حدود الذاكرة المؤقتة. الحل هو إنعاش ذاكرته بإعادة ذكر المعلومات الضرورية عند الحاجة.

- التفرعات المتعددة أو التعقيد الزائد في السؤال: لو طرحت سؤالًا يحتوي طلبات عديدة متداخلة دون تنظيم، فهناك احتمال أن يفوّت النموذج جزءًا أو يخلط بين المطلوب. مثلًا: “أخبرني عن تاريخ العلوم ثم اشرح نظرية أينشتاين باختصار وقارن بينها وبين نظرية أخرى.” هذا برومبت واحد يحوي 3 مهام. قد يحاول ChatGPT فعل كل ذلك، لكن قد تكون النتيجة سطحية أو غير مرتبة بالشكل المطلوب، لأن السؤال لم يحدد أولوية أو تسلسلًا واضحًا. في مثل هذه الحالة، قد ينجز مهمتين جيدًا ويغفل الثالثة دون قصد.

- عند تعارض التعليمات أو خروج الطلب عن المألوف: إذا أعطيت النموذج تعليمات مربكة أو متناقضة، فقد ينتج ردًا غير متوقع. مثال: “أجبني على هذا السؤال بإيجاز ولكن اذكر كل التفاصيل الممكنة.” هنا طلبك ذاته متناقض (موجز vs كل التفاصيل). سيحاول النموذج إيجاد حل وسط، وقد لا يرضيك أي منهما. كذلك بعض المستخدمين قد يحاولون “خداع” النموذج بتعليمات معاكسة لقواعده، ما يؤدي إلى رفضه أو رد مراوغ. هذه ليست بالضبط سوء فهم، لكنها حالات لا يلبي فيها ChatGPT الطلب كما أراد المستخدم بسبب طبيعة الطلب نفسه.

- محدودية المعرفة أو الخطأ في الاستنتاج: وأخيرًا، قد يسيء ChatGPT الفهم أحيانًا لأنه ببساطة لا يعرف سياقًا معينًا أو يفتقر إلى المنطق البشري الكامل. يمكنه التعامل جيدًا مع اللغة والمعرفة العامة ضمن حدود تدريبه والسياق المتاح له، لكنه قد يفشل في فهم نكتة خفية جدًا، أو سياق ثقافي خاص لم يتعرّض له في تدريبه، أو سؤال يتطلب استدلالًا معقّدًا خارج نطاق قدراته. فيظهر الرد وكأنه خاطئ أو غير ذي صلة.

لتجنب سوء الفهم قدر الإمكان: اجعل سؤالك واضحًا ومحددًا، ووفّر أي سياق يحتاجه النموذج، وتحقق من عدم وجود غموض في عبارتك. إذا حصلت على إجابة غير مرضية، يمكنك دائمًا إعادة صياغة سؤالك بشكل أوضح؛ كثيرًا ما يحل ذلك المشكلة على الفور.

6 نصائح عملية لجعل أسئلتك أوضح وأكثر قابلية للفهم

إليك ست نصائح تساعدك في صياغة برومبت (سؤال أو طلب) واضح يضمن فهم ChatGPT لما تريد تمامًا، وبالتالي حصولك على إجابات أفضل:

- كن واضحًا ومحددًا قدر الإمكان: تجنّب الأسئلة العامة أو المبهمة. اذكر بالضبط ما الذي تبحث عنه. على سبيل المثال، بدلًا من أن تسأل “أعطني معلومات عن التكنولوجيا” (واسع جدًا)، اسأل “ما هي أحدث التقنيات في مجال الطاقة الشمسية لعام 2026؟” الوضوح والتحديد يوجهان النموذج مباشرة نحو الإجابة المستهدفة.

- وفّر السياق الضروري: إذا كان سؤالك يتعلق بشيء ذكرته سابقًا أو بمعلومات ليست معروفة عامة، فقم بتوفير توضيح سريع. على سبيل المثال: “أنا معلّم علوم أسأل عن طريقة مبسطة لشرح مفهوم الثقب الأسود للطلاب. كيف أشرح ذلك؟” هنا ذكرت أنك معلّم والهدف شرح للطلاب – هذا سياق سيساعد ChatGPT على تخصيص الإجابة للمستوى المطلوب. لا تفترض أن النموذج يعرف ما في ذهنك؛ أي معلومة خلفية تضيفها قد تغيّر وتحسّن جودة الرد.

- قسّم الطلبات المعقدة إلى خطوات: إذا كان لديك طلب معقّد أو متعدد الأجزاء، فمن الأفضل تقسيمه أو على الأقل ترتيبه بتسلسل منطقي. يمكنك ترقيم المطلوبات أو استخدام عبارات مثل “أولًا”، “ثم” في نص سؤالك. مثلًا: “أولًا، لخص النص التالي. ثم أوضح أهم نتيجتين منه.” هذه البنية الواضحة تجعل النموذج يدرك أن عليه الإجابة على جزئين بالتتابع وعدم إغفال أي منهما.

- استخدام لغة بسيطة ومباشرة: اختر كلماتك بعناية لتجنّب اللبس. ابتعد عن الضمائر غير المحددة (هذا، هذه، هم…) إلا لو كان مرجعها واضحًا من السياق. كذلك تجنب الجمل شديدة التعقيد نحويًا التي قد تربك النموذج. ليس عليك التصنع – فقط اكتب بشكل منظم. أيضًا، حاول تجنب الأخطاء الإملائية الكبيرة أو العامية الشديدة (إلا إذا كان قصدك أن يجيب بالعامية) لأن النموذج قد يفسرها خطأ. اللغة العربية الفصحى البسيطة هي الخيار الأمثل لضمان الفهم.

- حدد الشكل المطلوب للإجابة إن لزم: إذا كنت تريد الإجابة في شكل معين (نقاط، فقرة، جدول، كود برمجي،…) فاذكر ذلك بوضوح في سؤالك. على سبيل المثال: “أعطني الإجابة في جدول يقارن بين X و Y من حيث التكلفة والمميزات.” أو “أجبني في ثلاث نقاط مختصرة.” النموذج بارع في اتباع التعليمات الشكلية متى فهمها، لذا استفد من ذلك لضبط المخرجات وفق رغبتك.

- راجع سؤالك بعين القارئ قبل الإرسال: أخيرًا، خذ لحظة وأعد قراءة ما كتبته وكأنك أنت ChatGPT الذي سيجيب. هل لديك كل ما يلزم لفهم المطلوب؟ هل هناك أي احتمال لتفسير مختلف؟ هذه المراجعة البسيطة قد تكشف لك مواضع تحتاج لتوضيح أكثر قبل أن تنقر “إرسال”. إن وجدت أي غموض، عدّل السؤال. هذه الخطوة تضمن أن برومبتك جاهز تمامًا للفهم السليم.

باتباع هذه النصائح، ستزيد كثيرًا من احتمال أن يفهم ChatGPT أسئلتك من المرة الأولى دون حاجة لإيضاحات إضافية، مما يعني إجابات أدق وأقرب لما تريد.

الخلاصة العملية:

- يتعامل ChatGPT مع سؤالك على مستوى التوكنات وليس الكلمات المفردة، ثم يحلله ضمن نافذة سياق محدودة. لذا، اجعل كل كلمة في سؤالك محسوبة ومفيدة.

- يعتمد النموذج على فهم النية والمعنى من خلال ما تكتبه صراحةً والسياق الذي توفّره. اذكر ما تريده تحديدًا وأي تفاصيل أو معلومات خلفية تساعد في توضيح مقصدك.

- هنالك تراتبية تعليمات تحكم سلوك ChatGPT، فهو ملتزم بقواعد وأطر عامة أولًا ثم بطلبك أنت. صغ أسئلتك بطريقة لا تتعارض مع تلك القواعد (كأن تتجنب المطالب المخالفة للسياسات)، وستحصل على تعاون أفضل من النموذج.

- إذا حصل سوء فهم، فقد يكون السبب في صياغة السؤال، أو نقص السياق، أو طول المحادثة، أو حدود النموذج نفسه. لا تتردد في إعادة صياغة البرومبت بشكل أوضح أو تفصيلي أكثر. تجربة بعد أخرى ستتعلم كيف يستجيب النموذج وما نوع المعلومات التي تساعده على تقديم إجابة أفضل.

- أخيرًا، التواصل الواضح هو المفتاح. تعامل مع ChatGPT كزميل ذكي لكنه يعتمد كليًا على نصك المكتوب ليفهمك. كلما أحسنت الوصف والتوجيه، جاءك الرد أكثر دقة وملاءمة.

أخطاء شائعة عند طرح الأسئلة على ChatGPT

وحتى نوضح أهمية ما سبق، هذه بعض الأخطاء الشائعة التي يقع فيها المستخدمون عند كتابة البرومبت، مما يؤدي لردود أقل جودة – مع أمثلة على كل حالة وكيفية تصحيحها:

- طرح سؤال عام جدًا دون تحديد المطلوب:

مثال سؤال ضعيف: “أعطني معلومات عن المناخ.” (هذا طلب واسع وفضفاض للغاية)

مثال سؤال محسّن: “أعطني لمحة سريعة عن آثار التغير المناخي على المدن الساحلية.” – السؤال المحسّن محدد بموضوع وجانب معين، مما يساعد النموذج على إعطاء إجابة مركزة بدلًا من العموميات. - غياب السياق أو المرجعية في السؤال:

مثال سؤال ضعيف: “حلّل هذه النظرية واكتب رأيك.” (ما هي النظرية؟ ليس لدى النموذج مرجع هنا)

مثال سؤال محسّن: “نظرية XYZ تنص على كذا وكذا (ملخص سريع). ما رأي الخبراء فيها وما أبرز الانتقادات الموجهة لها؟” – هنا زودنا النموذج باسم النظرية بل وخلفية مختصرة عنها، فجعلنا المهمة واضحة بدل أن ندعوه يحزر المقصود. - استخدام إشارات غامضة مثل “هذا/هذه” بدون توضيح:

مثال: في محادثة ما، كتبت ردًا للمساعد: “هل يمكنك شرح هذه أكثر؟”. كلمة “هذه” قد تكون غير واضحة مرجعها إذا كانت هناك مواضيع متعددة تم ذكرها سابقًا. ChatGPT ربما سيخمن المقصود ولكن قد يخطئ. التصحيح: تحديد المرجع، مثلًا: “هل يمكنك شرح هذه الفكرة أكثر؟ أقصد الفكرة المتعلقة بتعليم الآلة.” الآن زال الغموض. - دمج طلبات متعددة في سؤال واحد بشكل مربك:

مثال: “أخبرني بتاريخ الكمبيوتر، وما هي أحدث الابتكارات التقنية، وهل تعتقد أن الذكاء الاصطناعي سيتفوق على الإنسان؟” – هذا السؤال في الحقيقة ثلاثة أسئلة مختلفة في جملة واحدة! سيحاول النموذج الإجابة على الكل وربما بتوازن غير مرضٍ. الأفضل فصلها أو على الأقل ترتيبها: “أولًا: أعطني لمحة عن تاريخ الحاسوب. ثانيًا: ما أحدث الابتكارات التقنية اليوم؟ ثالثًا: برأيك، هل سيتفوق الذكاء الاصطناعي على الإنسان يومًا ما؟”. الآن لدى النموذج هيكل واضح للتعامل مع كل جزء. - افتراضات غير صحيحة حول معرفة النموذج:

بعض المستخدمين يطرحون أسئلة تفترض معرفة سابقة مثل: “تذكر تلك المعلومة التي أخبرتك بها الأسبوع الماضي”. على مستوى النموذج، تعتمد الاستجابة على السياق الذي يتم تمريره له في تلك اللحظة، لكن ChatGPT كمنتج قد يستخدم أيضًا ميزات مثل Memory وChat history بحسب إعدادات الحساب. ومع ذلك، قد تتوفر ميزات مثل Memory أو Chat history التي تسمح للنظام بالاحتفاظ ببعض المعلومات بين الجلسات إذا كانت مفعّلة. لذلك من الأفضل دائمًا إعادة ذكر المعلومات المهمة داخل نفس المحادثة لضمان أن تكون ضمن السياق الذي يستخدمه النموذج في الإجابة. كما أنه لا يطّلع تلقائيًا على أمور حدثت خارج السياق الذي أُتيح له. لذا أي سؤال يعتمد على ذاكرة أطول من حدود المحادثة الحالية سيؤدي لإجابة خاطئة أو اعتذار. الحل: توفير المعلومات من جديد في نفس المحادثة عند الحاجة.

تجنّب هذه الأخطاء سيضمن تواصلًا أكثر سلاسة مع ChatGPT ويقلل من حالات سوء الفهم بشكل ملحوظ.

الأسئلة الشائعة (FAQ)

هل يفهم ChatGPT اللغة العربية بنفس كفاءة فهمه للإنجليزية؟

يفهم ChatGPT العربية ويستطيع إنتاج إجابات جيدة بها، لكن لا ينبغي الجزم بأنها بنفس كفاءة الإنجليزية في كل الحالات. فOpenAI تذكر أن نماذجها مدرّبة على بيانات متعددة اللغات وقادرة على تقديم نتائج عالية الجودة عبر لغات كثيرة، مع بقاء الإنجليزية اللغة الأكثر تحسينًا في بعض السياقات.

ما حجم الذاكرة التي يمتلكها ChatGPT أثناء المحادثة؟ وهل يتذكر كل شيء أقوله له؟

ChatGPT يتذكر محتوى المحادثة ضمن ما يسمى نافذة السياق (Context Window)، وهي عدد محدد من التوكنات التي يمكن للنموذج استخدامها أثناء توليد الرد. تختلف سعة هذه النافذة باختلاف النموذج والإصدار. إذا أصبحت المحادثة طويلة جدًا، فقد لا تبقى الأجزاء الأقدم كلها ضمن السياق المستخدم لتوليد الرد للحفاظ على المساحة المتاحة للرسائل الأحدث.

ومع ذلك، من المهم التمييز بين نافذة السياق وميزة الذاكرة (Memory). على مستوى النموذج نفسه، كل استجابة تعتمد فقط على السياق الذي يتم تمريره له في تلك اللحظة. لكن ChatGPT كمنتج يوفّر الآن ميزات مثل Memory و Chat history، وفي بعض الحالات Project memory داخل المشاريع. كما يمكن للمستخدم تعطيل الذاكرة أو استخدام Temporary Chat إذا أراد محادثة لا يتم حفظ معلوماتها. لذلك لا يمكن القول إن جميع الجلسات منفصلة دائمًا، كما لا يمكن افتراض أن النموذج يتذكر كل شيء بشكل غير محدود؛ فالأمر يعتمد على إعدادات الحساب والميزات المفعّلة.

لماذا قد يقدم ChatGPT أحيانًا إجابة غير صحيحة أو غريبة رغم أن سؤالي واضح؟

هناك سببان رئيسيان لذلك: الأول، قد يكون السؤال واضحًا جدًا بالنسبة لك لكنه يحمل في طياته تعقيدًا أو يتطلب استدلالًا عميقًا يصعب على النموذج. ChatGPT يولد الإجابات اعتمادًا على الأنماط في البيانات والسياق المتاح له، وقد يخطئ أو يقدم معلومات غير دقيقة، لذلك ينبغي التحقق من المعلومات المهمة. لذلك قد يقع في أخطاء منطقية أو يقدم معلومات غير دقيقة تُعرف باسم “هلوسة“. السبب الثاني، ربما سؤالك واضح لكن الموضوع نفسه لا يملك عنه النموذج معلومات كافية، خصوصًا إذا كان الموضوع أحدث من تاريخ معرفة النموذج أو إذا أجاب دون استخدام أدوات حديثة. أما عندما تُستخدم أدوات مثل البحث على الويب أو البحث المتعمق، فيمكن لـChatGPT الاستناد إلى مصادر حديثة مع روابط أو استشهادات.

إذا شعرت أن ChatGPT لم يفهم سؤالي جيدًا، ماذا يمكنني أن أفعل؟

أفضل ما يمكنك فعله هو إعادة صياغة سؤالك بشكل أوضح أو أكثر تفصيلًا. يمكنك أيضًا أن تضيف توضيحًا لما أردته بالضبط. على سبيل المثال، إذا طرحت سؤالًا ولم تكن الإجابة على الجانب الذي تريده، جرّب أن تقول: “ما قصدته بالسؤال هو كذا وكذا…” أو اطرح السؤال من زاوية مختلفة. ChatGPT يتقبل إعادة الأسئلة ومحاولات التوضيح بشكل إيجابي، وغالبًا سيفهم قصدك في المرة الثانية. أيضًا يمكنك أن تطلب منه مباشرة: “هل فهمت قصدي؟ أقصد بذلك…” وسترى أنه إما يشرح لك فهمه (لتتأكد إن كان صحيحًا) أو يطلب مزيدًا من التوضيح إن لزم الأمر.

هل طريقة تفاعلي مع ChatGPT في منصة GPT Gate تؤثر على الفهم؟

منصة GPT Gate تقدم لك واجهة ChatGPT باللغة العربية وتجربة مصممة للمستخدم العربي، لكنها في النهاية تعتمد على نفس نموذج OpenAI في الخلفية. طريقة تفاعلك – من حيث وضوح الأسئلة وتوفير السياق واستخدام اللغة – هي العامل الحاسم في مدى فهم النموذج لك. قد تضيف بعض الواجهات أو المنصات إعدادات أو توجيهات مخصصة تؤثر في أسلوب الإجابة، لكن تذكّر أن جودة الإجابة تبدأ من جودة السؤال. المنصة تيسر لك الأمر باللغة التي ترتاح بها، ولكن عليك أنت صياغة مدخلاتك بعناية لتحصل على أفضل نتائج. الخبر الجيد أن النصائح والإرشادات المذكورة في هذا المقال تنطبق تمامًا سواء كنت تستخدم ChatGPT عبر GPT Gate أو عبر أي واجهة أخرى. فالأساس واحد: تواصل واضح يحقق فهمًا أفضل.